在数字化转型加速的2026年,企业对IT基础设施的选择已不仅关乎技术架构,更直接影响其业务敏捷性、合规能力、成本结构乃至长期竞争力。面对“自建私人IDC”(Private Internet Data Center)与“采用大厂公有云”(如阿里云、腾讯云、华为云、AWS、Azure、Google Cloud等)两大路径,决策者常陷入两难:一边是高度可控但投入巨大的传统模式,另一边是弹性灵活却隐含复杂性的现代云范式。

本文旨在提供一份全面、系统、深入的对比分析,涵盖从物理层到应用层、从财务模型到组织能力的12个核心维度,并结合实际场景给出战略建议。全文约12,000字,力求为技术负责人、CIO、CTO及企业战略制定者提供可操作的决策参考。

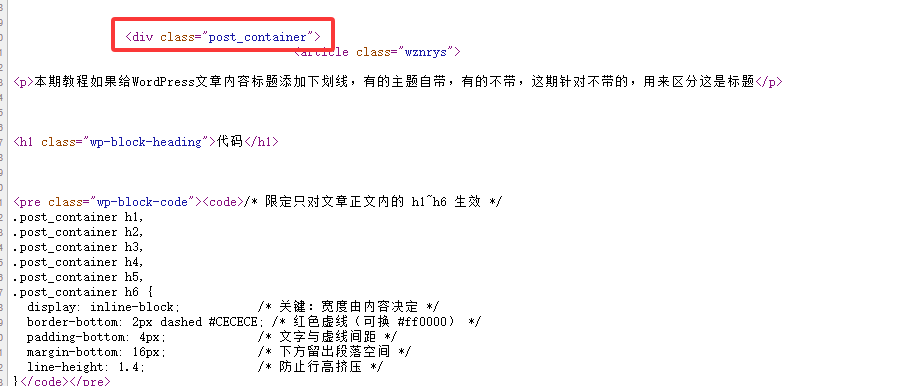

一、定义与范畴澄清

- 私人IDC(Private IDC)

指企业自主投资、建设、运维的数据中心,包括机房物理设施(电力、制冷、安防)、网络架构、服务器/存储设备及内部运维体系。可以是完全自建(On-Premises),也可以是租用第三方机柜但完全自主管理(Colocation + Self-Managed)。 - 大厂云服务(Hyperscaler Public Cloud)

指由超大规模云服务商(如阿里云、AWS等)提供的IaaS/PaaS/SaaS服务,用户通过互联网或专线按需使用虚拟化资源,典型特征包括多租户架构、自动化运维、全球节点部署和按量计费。

注意:本文不讨论私有云(如OpenStack)、混合云平台(如VMware Cloud)或边缘计算专用方案,除非特别说明。

二、对比维度详解

以下从12个关键维度进行逐项对比,每项均包含技术细节、成本影响、适用场景及潜在风险。

维度1:控制权与自主性(Control & Autonomy)

私人IDC:

- 完全掌控硬件生命周期:可自由选择CPU型号(如Intel Xeon vs. AMD EPYC)、内存频率、NVMe SSD品牌、网卡驱动版本等。

- 网络完全自定义:支持BGP路由、自建Anycast、部署专用防火墙(如Palo Alto)、定制QoS策略。

- 可深度优化底层栈:例如为AI训练集群关闭CPU节能模式、调整NUMA绑定、启用RDMA over Converged Ethernet (RoCE)。

- 物理安全自主:门禁、摄像头、访客登记均由企业控制,符合军工级或金融级审计要求。

大厂云:

- 控制限于虚拟层:用户可配置vCPU数量、内存大小、安全组规则,但无法接触物理设备。

- 底层变更不可控:云厂商可能在维护窗口自动升级宿主机固件或迁移实例,虽通常无感,但极端情况下可能引发兼容性问题。

- 网络抽象化:VPC、NAT网关、负载均衡器均为逻辑组件,无法直接操控物理交换机或光模块。

- 依赖API治理:所有操作需通过厂商SDK或控制台,存在API限流、功能滞后等限制。

结论:对底层性能、合规审计、特殊硬件需求强的场景(如高频交易、国家关键信息基础设施),私人IDC优势显著;通用业务则云服务足够。

维度2:资本支出 vs. 运营支出(CapEx vs. OpEx)

私人IDC:

- 初始投入高:以中型IDC(500机柜)为例,土地/机房建设约2–5亿元,服务器/网络设备约8,000万–1.5亿元,电力配套(双路市电+柴油发电机+UPS)约3,000万。

- 折旧周期长:服务器通常3–5年更换,机房建筑可达20年。

- 边际成本低:一旦建成,新增一台服务器仅需采购成本+电费(约¥3,000–¥8,000/年)。

- 隐性成本高:包括运维人力(至少10人团队)、备件库存、保险、消防年检等。

大厂云:

- 零初始投入:无需购置硬件,开通账号即可使用。

- 按需付费:ECS实例、RDS数据库、对象存储等均按秒/小时计费,支持预留实例(RI)或节省计划(Savings Plans)降低长期成本。

- 成本可预测性差:突发流量、配置错误(如未关闭测试实例)易导致账单飙升。

- 长期成本可能更高:据Gartner研究,稳定运行5年以上的业务,上云总成本平均高出自建IDC 30%–60%。

案例:某电商平台日均10万订单,若全部上云,年云支出约¥2,400万;若自建IDC,第1年投入¥1.2亿,后续年运维成本约¥600万,第3年起成本反超云。

结论:短期项目、波动业务选云;长期稳定负载、高资源利用率场景选IDC。

维度3:弹性与扩展能力(Elasticity & Scalability)

私人IDC:

- 扩容周期长:采购服务器需4–8周,机房电力扩容可能需6个月以上。

- 扩展上限明确:受限于机柜空间、电力容量(如2MW上限)、冷却能力。

- 适合稳态业务:如核心ERP、主数据库、内部OA系统。

大厂云:

- 秒级扩容:Auto Scaling可自动增减实例,应对“双11”级流量峰值。

- 几乎无限资源池:AWS单区域可提供数百万vCPU,阿里云支持跨Region容灾。

- 支持Serverless:如AWS Lambda、阿里云函数计算,实现“零服务器”架构。

但需注意:弹性依赖良好架构设计。若应用未做无状态改造,单纯增加实例无效。

结论:高并发、事件驱动、全球化部署业务强烈依赖云弹性;内部系统无需频繁扩缩容。

维度4:性能与延迟(Performance & Latency)

私人IDC:

- 网络延迟极低:同机房内服务器间通信延迟<0.1ms,适合分布式数据库(如TiDB)、实时风控系统。

- 无“噪声邻居”:独占物理资源,避免公有云多租户干扰(Noisy Neighbor Problem)。

- 存储IOPS可控:可部署全闪存阵列(如Dell PowerStore),保障数据库TPS。

大厂云:

- 虚拟化开销:Hypervisor引入约3%–8% CPU性能损耗,网络虚拟化(如VXLAN)增加微秒级延迟。

- 实例性能波动:共享宿主机可能导致CPU争抢,尤其在非专属实例(如t系列)上。

- 但高端实例优化显著:如阿里云g8i(Intel Sapphire Rapids)、AWS Graviton3,性能接近裸金属。

例外:云厂商提供“裸金属实例”(Bare Metal),如阿里云ebm、AWS i4i,兼具云管理与物理性能,但价格高昂。

结论:对延迟敏感(<1ms)、高吞吐(>100万IOPS)场景仍推荐IDC;一般Web应用云性能足够。

维度5:安全性与合规性(Security & Compliance)

私人IDC:

- 数据主权清晰:数据不出园区,满足《网络安全法》《数据安全法》《个人信息保护法》要求。

- 审计路径完整:可全程监控物理访问、日志留存、操作录像。

- 合规认证自主:可申请等保三级、ISO 27001、PCI DSS等,但需自行投入人力。

大厂云:

- 共享责任模型:云厂商负责“云的安全”(物理、网络、虚拟化层),用户负责“云上安全”(OS、应用、数据加密)。

- 合规能力强大:主流云商均通过等保三级、GDPR、HIPAA、FedRAMP等认证,甚至提供政务云专区(如阿里政务云)。

- 但多租户风险存在:历史上曾发生跨租户漏洞(如Spectre、Meltdown),虽罕见但影响巨大。

- 数据跨境问题:若业务涉及欧盟或美国,需确认云厂商数据中心位置及数据驻留策略。

结论:金融、政务、医疗等强监管行业倾向IDC;跨国企业可利用云厂商全球合规资质。

维度6:运维复杂度与人才需求(Operational Complexity)

私人IDC:

- 需全栈运维团队:网络工程师(BGP/OSPF)、系统管理员(Linux/Windows)、存储专家(SAN/NAS)、电力工程师。

- 故障响应慢:硬件故障需现场处理,MTTR(平均修复时间)可能达数小时。

- 自动化程度低:虽可用Ansible、SaltStack,但底层依赖人工干预。

大厂云:

- 运维大幅简化:自动打补丁、故障迁移、日志聚合(如CloudWatch、SLS)、备份快照均由平台完成。

- DevOps友好:CI/CD可无缝集成云原生服务(如Kubernetes、Serverless)。

- 但“黑盒”问题突出:当遇到底层Bug(如ENI丢包、EBS延迟突增),排查依赖厂商支持,SLA响应时间通常为4–24小时。

结论:中小团队无力承担IDC运维,应优先上云;大型企业可组建SRE团队驾驭混合架构。

维度7:灾备与高可用(Disaster Recovery & HA)

私人IDC:

- 异地灾备成本高:需建设第二个IDC(通常距离>100km),投入翻倍。

- RPO/RTO较长:基于磁带或异步复制,RPO可能达分钟级,RTO数小时。

- 但可控性强:可自定义切换流程,避免云厂商区域性故障(如AWS us-east-1中断)影响全局。

大厂云:

- 多AZ/Region天然支持:如阿里云同城三中心、AWS Multi-AZ RDS,RPO≈0,RTO<30秒。

- 服务内置高可用:SLB自动剔除故障节点,OSS三副本存储。

- 但“单点依赖”风险:若过度依赖单一云厂商,其区域性故障将导致全站瘫痪(参考2021年Fastly、2023年Azure全球中断事件)。

最佳实践:关键业务采用“多云灾备”或“云+IDC”混合模式。

维度8:技术演进与创新速度(Innovation Velocity)

私人IDC:

- 技术更新慢:硬件升级周期3–5年,难以快速试用新CPU、GPU、DPU。

- 创新成本高:部署Kubernetes、Service Mesh需自研或集成开源方案。

大厂云:

- 快速迭代:每年发布数百项新服务(如AI模型即服务、量子计算模拟器)。

- 开箱即用:一键部署Redis集群、ClickHouse、Flink,降低技术门槛。

- 生态丰富:Marketplace提供第三方SaaS集成,加速业务上线。

结论:追求技术前沿、快速试错的团队应拥抱云;保守型行业可暂缓。

维度9:网络与互联能力(Networking & Interconnectivity)

私人IDC:

- BGP自治:可申请ASN,自建Anycast DNS,优化全球访问路径。

- 专线成本高:接入三大运营商BGP需支付端口费+流量费(约¥10万/月/Gbps)。

- 跨地域互联弱:分支机构访问IDC需经公网或MPLS,延迟高。

大厂云:

- 全球骨干网:阿里云高速通道、AWS Global Accelerator提供低延迟跨Region通信。

- 云企业网(CEN):一键打通VPC、本地IDC、分支办公室。

- 但出口带宽贵:公网出流量价格约¥0.8/GB,远高于IDC批发价(¥0.2/GB)。

策略建议:IDC用于内网核心,云用于公网入口+边缘节点。

维度10:可持续性与绿色计算(Sustainability)

私人IDC:

- PUE(电源使用效率)通常1.5–2.0,老旧机房甚至>2.5。

- 碳排放高:依赖市电,绿电采购能力弱。

- 但可自建光伏/储能系统(如腾讯天津IDC)。

大厂云:

- 超大规模效应:阿里云张北数据中心PUE低至1.13,Google Cloud全球平均PUE 1.1。

- 承诺碳中和:AWS目标2025年100%可再生能源,阿里云2030年实现净零。

- 提供碳足迹工具:如Azure Sustainability Calculator。

ESG趋势下,云服务在绿色计算方面更具优势。

维度11:供应商锁定(Vendor Lock-in)

私人IDC:

- 几乎无锁定:硬件标准化(x86、NVMe),软件可迁移。

- 但迁移成本高:物理搬迁需停机,数据同步复杂。

大厂云:

- 深度锁定风险:大量使用厂商专属服务(如AWS DynamoDB、阿里云Tablestore),迁移到其他云或IDC需重写代码。

- 解决方案:采用CNCF标准(Kubernetes、Prometheus)、Terraform IaC、抽象中间件层。

建议:核心业务避免重度依赖PaaS,优先使用IaaS+开源软件。

维度12:组织文化与变革阻力(Organizational Impact)

私人IDC:

- 运维团队话语权高,但易形成“烟囱式”架构。

- 创新受阻:资源申请需走审批流程,开发效率低。

大厂云:

- 推动DevOps文化:开发可自助申请资源,加速交付。

- 但财务管控挑战:云账单分散,需建立FinOps机制。

成功上云不仅是技术迁移,更是组织变革。

三、典型场景选型建议

| 场景 | 推荐方案 | 理由 |

|---|---|---|

| 互联网初创公司(0–1阶段) | 全部上大厂云 | 低成本启动,快速迭代,无需运维负担 |

| 金融机构核心交易系统 | 私人IDC + 云灾备 | 满足等保四级,低延迟,强审计 |

| 全球电商(大促流量波动) | 大厂云(多Region) | 弹性扩容,CDN加速,支付合规 |

| 制造业MES/ERP系统 | 私人IDC | 负载稳定,数据敏感,与OT网络隔离 |

| AI训练集群(千卡GPU) | 私人IDC(或云裸金属) | 高带宽互联(NVLink/RoCE),成本可控 |

| 政务云平台 | 专属云(如Apsara Stack) | 数据不出省,合规+云体验兼顾 |

四、未来趋势:融合而非取代

- 混合云成为主流:Gartner预测,到2027年80%企业将采用混合云架构。

- 专属云/托管私有云兴起:如阿里云Apsara Stack、华为云Stack,提供“云体验+本地部署”。

- 边缘IDC + 中心云协同:5G/物联网推动“云边端”一体化。

- FinOps文化普及:企业建立云成本治理团队,优化资源使用。

结语:没有“最好”,只有“最合适”

私人IDC与大厂云并非对立选项,而是企业IT基础设施光谱的两端。真正的智慧在于根据业务属性、发展阶段、合规要求、人才储备进行动态权衡。在2026年这个云原生与AI原生交织的时代,最成功的组织不是全盘上云或固守IDC,而是构建“以业务为中心、以数据为纽带、以弹性为原则”的混合基础设施战略。

最终,技术选型的本质,是对“控制、成本、速度”三角关系的持续再平衡。而这场平衡的艺术,正是数字时代企业竞争力的核心体现。